Ordinateur quantique en entreprise : applications réelles, acteurs clés et calendrier 2026-2033

L’informatique quantique est sortie des laboratoires. Boeing modélise des matériaux d’aéronefs sur des processeurs IBM. Mercedes-Benz simule la chimie des batteries lithium-ion via Qiskit. ExxonMobil teste des algorithmes d’optimisation pour ses flux logistiques. McKinsey estime le marché à 1 300 milliards de dollars d’ici 2035. Pourtant, dans la plupart des PME et ETI françaises, le sujet reste flou : entre la promesse de calculs un million de fois plus rapides et la réalité d’un matériel qui plante toutes les quelques secondes, il y à un fossé que les communiqués de presse ne comblent pas.

Ce guide démêle ce qui est faisable aujourd’hui de ce qui relève encore de la roadmap. On parle qubits, avantage quantique, acteurs réels, cas d’usage chiffrés, et surtout calendrier. Pas de promesses creuses : les premiers avantages quantiques industriels sont attendus fin 2026 selon IBM, et la pleine maturité avec correction d’erreurs viendra autour de 2029-2033. Voilà le terrain de jeu.

Comprendre l’ordinateur quantique sans formules

Un ordinateur classique manipule des bits. Chaque bit vaut 0 ou 1. Point. Un ordinateur quantique manipule des qubits, et c’est là que la physique devient bizarre. Un qubit peut valoir 0, ou 1, ou les deux à la fois dans des proportions variables. Cette propriété s’appelle la superposition.

Imaginez un labyrinthe. Pour en sortir avec un ordinateur classique, vous testez chaque chemin l’un après l’autre. Dans des cas simples, c’est rapide. Dans des cas complexes (la simulation moléculaire d’un médicament, par exemple), même un supercalculateur de 100 millions de cœurs prend des décennies. Un ordinateur quantique, lui, n’explore pas tous les chemins en parallèle (c’est l’image qu’on lit partout, et elle est fausse). Il manipule des amplitudes de probabilité qui s’amplifient ou s’annulent par interférence, jusqu’à ne laisser que la solution correcte.

La conséquence pratique ? Pour environ 1% des problèmes industriels, le quantique apportera un gain massif. Pour les 99% restants (votre ERP, votre site e-commerce, vos tableurs), un PC classique restera mieux adapté pendant longtemps. Cette nuance change toute la stratégie d’investissement.

Qubit, superposition, intrication : les briques techniques

Quatre principes définissent la machine quantique : superposition, intrication, interférence et décohérence. Les trois premiers sont des ressources, le quatrième un ennemi.

L’intrication est la propriété la plus contre-intuitive. Deux qubits intriqués partagent leur état, même séparés physiquement. Mesurer l’un détermine instantanément l’information sur l’autre. Einstein appelait ça « l’action fantôme à distance ». C’est ce phénomène qui permet aux algorithmes quantiques de traiter de l’information d’une manière inaccessible aux machines classiques.

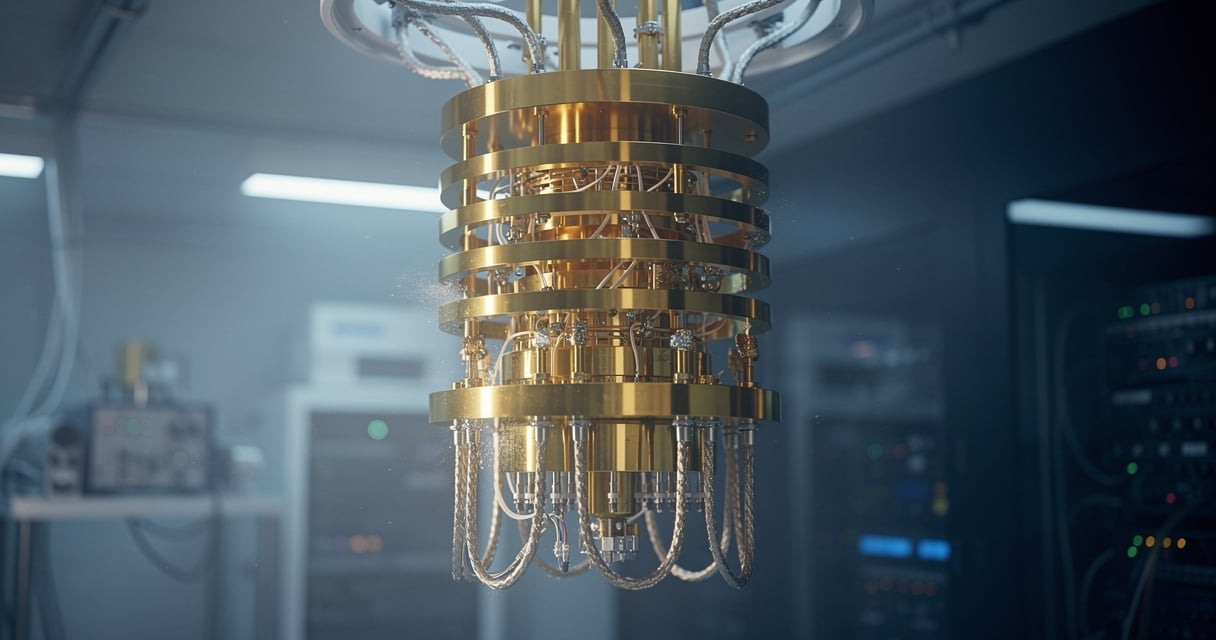

La décohérence, à l’inverse, est le casse-tête des ingénieurs. Dès qu’un qubit interagit avec son environnement (chaleur, vibration, photon parasite), il perd son état quantique et redevient un bit ordinaire. C’est pour ça que les processeurs IBM tournent à environ un centième de degré au-dessus du zéro absolu, plus froids que l’espace cosmique. Le système de refroidissement à l’hélium liquide pèse plusieurs centaines de kilos pour quelques centimètrès carrés de puce.

Plusieurs technologies de qubits coexistent :

| Type de qubit | Acteurs | Atout | Limite |

|---|---|---|---|

| Supraconducteur | IBM, Google, Rigetti | Vitesse de calcul, contrôle précis | Refroidissement extrême, coût |

| Ions piégés | IonQ, Quantinuum | Temps de cohérence longs, fiabilité | Beaucoup plus lent |

| Photonique | PsiQuantum, Xanadu | Communication longue distance | Maturité industrielle limitée |

| Atomes neutres | Pasqal, QuEra | Scalabilité prometteuse | Technologie récente |

| Points quantiques | Intel, Quantum Motion | Compatibilité semi-conducteurs | Encore en R&D |

Aucune technologie n’a encore gagné. C’est important pour vos décisions d’achat futures : un partenariat avec un fournisseur photonique ne donne pas accès aux mêmes algorithmes qu’un partenariat avec IBM. Choisir trop tôt, c’est risquer de miser sur le wagon Betamax.

Avantage quantique vs utilité quantique : la différence qui change tout

Deux termes circulent dans les annonces marketing, et les confondre coûte cher. L’utilité quantique, atteinte par IBM en 2023, désigne un calcul que la machine quantique sait faire de façon fiable, là où une simulation classique brute échouerait. L’avantage quantique va plus loin : c’est le moment où la machine quantique surclasse les meilleures méthodes classiques connues sur un problème pratique. Pas une démonstration de laboratoire, un gain réel et reproductible en production.

IBM annonce les premiers avantages quantiques industriels pour fin 2026. Google, plus prudent, parle de 2028-2029. Les analystes indépendants tablent plutôt sur 2030 pour des cas d’usage massifiés. La différence n’est pas anecdotique : entre une expérimentation que votre R&D peut explorer (utilité) et une technologie qui change vraiment vos coûts opérationnels (avantage), il y a 3 à 5 ans d’écart.

Cette zone grise, c’est exactement là où vos concurrents bougent ou ne bougent pas. JPMorgan a déjà 100 chercheurs quantiques. BNP Paribas en à une vingtaine. La plupart des banques régionales : zéro. À 5 ans d’horizon, l’écart pourrait devenir difficile à combler.

IBM, Google, IonQ : qui fait quoi sur le marché

Le paysage des acteurs s’est stabilisé autour de quelques grands pôles. IBM domine la pile logicielle ouverte : son SDK Qiskit compte plus de 600 000 utilisateurs inscrits et est enseigné dans environ 700 universités. Sa roadmap prévoit un système de 200 qubits logiques d’ici 2029 (nom de code IBM Starling), puis 2 000 qubits logiques en 2033. Pour donner un ordre de grandeur : 200 qubits logiques avec correction d’erreurs représentent un saut de plusieurs ordres de grandeur sur les 156 qubits physiques d’IBM Heron.

Google Quantum AI a fait sensation en décembre 2024 avec sa puce Willow et une démonstration de réduction d’erreurs « en dessous du seuil ». L’entreprise vise les premières applications industrielles autour de 2028.

IonQ, basé sur les ions piégés, mise sur la fiabilité plutôt que la vitesse. Le constructeur, coté en bourse depuis 2021, a signé des partenariats avec Hyundai (matériaux de batteries), Airbus (optimisation d’itinéraires) et l’US Air Force.

D’autres acteurs comptent : Microsoft Azure Quantum (plateforme cloud agnostique), Amazon Braket (idem côté AWS), Quantinuum (fusion Honeywell + Cambridge Quantum), et côté français Pasqal (atomes neutres, levée de 100 millions d’euros en 2023) et Quandela (photonique). La présence française est réelle, soutenue par le plan quantique de 1,8 milliard d’euros annoncé en 2021.

Applications concrètes pour l’entreprise en 2026

À court terme, quatre familles d’applications sortent du lot.

Optimisation logistique et financière. Volkswagen a publié dès 2019 une expérimentation sur l’optimisation du trafic à Lisbonne via un recuit quantique D-Wave. Goldman Sachs travaille avec IBM sur la valorisation d’options financières. Le principe : trouver le meilleur arrangement parmi des millions de combinaisons (tournées de livraison, allocation de portefeuille, planification de production). Ces problèmes plafonnent vite avec les solveurs classiques. Les premiers gains opérationnels sont attendus dès 2027 sur des sous-problèmes ciblés.

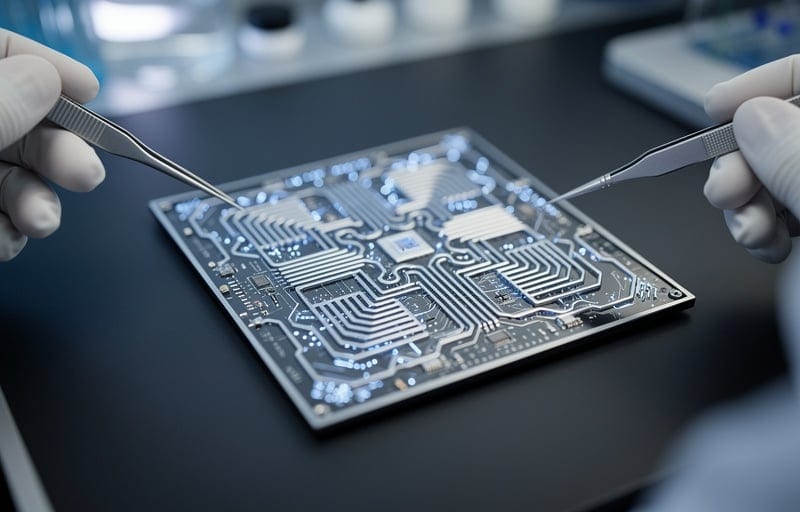

Simulation moléculaire et matériaux. C’est l’application où le quantique a l’avantage théorique le plus net. Mercedes-Benz utilise IBM Quantum pour modéliser la chimie des cathodes lithium-ion, espérant raccourcir le cycle R&D de 18 mois. Boeing simule des composites pour cellules d’avion. ExxonMobil cherche de nouveaux catalyseurs. Pfizer et Moderna explorent le repliement des protéines pour la conception de molécules thérapeutiques. Selon IBM, modéliser une molécule de caféine sur ordinateur classique nécessite environ 10^48 bits ; un ordinateur quantique le fait avec 160 qubits.

Apprentissage automatique quantique. Encore embryonnaire, mais prometteur sur les jeux de données très haute dimension (génomique, signaux satellitaires, fraude bancaire). Le NASA Ames Research Center et BBVA testent des algorithmes hybrides. Honnêtement : pour 95% des cas d’usage IA actuels, le quantique n’apporte rien à court terme. Ne vous laissez pas vendre un projet « ML quantique » sans cas d’usage validé.

Cryptanalyse et cryptographie post-quantique. Sujet à part, qu’on traite plus loin.

| Secteur | Cas d’usage prioritaire | Maturité 2026 | Acteurs pilotes |

|---|---|---|---|

| Finance | Pricing dérivés, optimisation portefeuille | Pilote | JPMorgan, Goldman Sachs, BNP |

| Pharma | Repliement protéines, conception molécules | R&D | Pfizer, Moderna, Roche |

| Automobile | Chimie batteries, conception matériaux | Pilote | Mercedes, BMW, Hyundai |

| Logistique | Optimisation tournées, supply chain | Démonstration | DHL, Volkswagen, Airbus |

| Énergie | Catalyseurs, exploration sismique | R&D | ExxonMobil, BP, TotalEnergies |

| Aéronautique | Composites, aérodynamique CFD | R&D | Boeing, Airbus, Lockheed Martin |

Cryptographie post-quantique : le chantier urgent

Voilà le sujet qui ne peut pas attendre. L’algorithme de Shor, publié en 1994, a démontré qu’un ordinateur quantique de taille suffisante casse les chiffrements RSA et ECC sur lesquels repose à peu près tout (HTTPS, signatures bancaires, certificats SSL, blockchain). Personne ne sait quand un tel ordinateur existera. Probablement pas avant 2030, peut-être 2035, peut-être plus tard. Mais la question n’est pas « si », c’est « quand ».

Le risque immédiat s’appelle « harvest now, decrypt later » : les services de renseignement et certains acteurs économiques aspirent dès aujourd’hui des flux chiffrés (emails, transferts bancaires, données de santé) en pariant qu’ils pourront les déchiffrer dans 10 à 15 ans. Si vos données ont une valeur stratégique sur cet horizon, elles sont déjà compromises.

Le NIST a publié en août 2024 ses premiers standards post-quantiques (ML-KEM, ML-DSA, SLH-DSA). L’ANSSI recommande une transition hybride dès 2025, avec un objectif de chiffrement résistant au quantique pour les données sensibles d’ici 2030. Les actions concrètes pour une DSI :

- Inventorier les usages cryptographiques (TLS, VPN, signature électronique, stockage chiffré)

- Identifier les données dont la valeur dépasse 10 ans (R&D, dossiers médicaux, secrets d’affaires)

- Demander à vos fournisseurs cloud leur roadmap post-quantique (AWS, Azure et GCP ont commencé)

- Tester les bibliothèques OpenSSL 3.5 ou liboqs en environnement de pré-production

Ce chantier ne demande aucun investissement matériel quantique. Il demande du temps DSI et de la rigueur. Reporter, c’est accepter une fuite massive à terme.

Calendrier réaliste : ce qui arrive entre 2026 et 2033

Trop d’analyses présentent le quantique comme un mur qu’on franchira d’un coup. Faux. La progression est graduelle, par paliers.

2026-2027. Premiers avantages quantiques sur des sous-problèmes précis (chimie de petites molécules, optimisation combinatoire de taille moyenne). Disponibilité commerciale via IBM Quantum, AWS Braket, Azure Quantum. Démarrage du déploiement post-quantique sur les flux les plus sensibles. Coût d’accès : entre 1 500 et 5 000 euros par mois pour un accès cloud, plus le coût d’un consultant ou d’un ingénieur formé.

2028-2029. Arrivée des premiers systèmes à correction d’erreurs viables (IBM Starling, Google équivalent). 200 qubits logiques. Cas d’usage industriels en simulation moléculaire qui battent franchement les méthodes classiques. Les grandes banques, pharmas et énergéticiens passent en production sur des modules ciblés.

2030-2033. Maturité industrielle. 2 000 qubits logiques chez IBM. Le quantique devient un service intégré aux supercalculateurs classiques (architecture hybride HPC + QPU). Les ETI commencent à y avoir accès via SaaS, sans construire d’expertise interne lourde. La cryptographie post-quantique est généralisée.

Au-delà de 2033, les prévisions deviennent spéculatives. Personne ne sait si on atteindra le million de qubits logiques (nécessaire pour casser RSA-2048) en 2035, 2040 ou plus tard. Bâtir une stratégie sur cet horizon est imprudent.

Comment préparer son entreprise dès aujourd’hui

Inutile d’acheter un ordinateur quantique. Personne n’en a besoin. La bonne posture dépend de la taille et du secteur.

Pour une PME hors secteurs stratégiques (commerce, services B2B classiques), faire trois choses suffit : suivre la migration post-quantique imposée par les régulateurs, demander à ses prestataires SaaS leur roadmap, et garder un œil sur les annonces sectorielles. Investir maintenant dans une compétence quantique interne est prématuré. Le retour sur investissement est trop incertain.

Pour une ETI ou un grand compte dans la pharma, l’énergie, la finance, la défense ou l’automobile, l’attentisme coûte cher. Les actions utiles :

- Former un noyau de 2 à 5 personnes (data scientists ou ingénieurs R&D existants) à Qiskit ou Cirq via les cours gratuits d’IBM Quantum Learning

- Lancer un proof-of-concept sur un cas d’usage précis (jamais sur « le quantique en général »), avec un budget plafonné à 100-200 K€ sur 6-12 mois

- S’inscrire à un réseau d’utilisateurs comme l’IBM Quantum Network ou Quantum Industry Consortium

- Surveiller les acteurs français du domaine (Pasqal, Quandela, Alice & Bob) : un partenariat technologique précoce vaut souvent mieux qu’un client SaaS tardif

Le piège classique : commander une étude de cabinet à 200 K€ qui dort dans un tiroir. Les meilleurs résultats viennent d’équipes opérationnelles qui ont mis les mains dans le code, même sur des notebooks Jupyter modestes. Qiskit s’apprend en quelques semaines pour quelqu’un qui maîtrise Python et l’algèbre linéaire.

Pour creuser les sujets connexes, voir notre dossier sur les tendances technologiques qui rebattent les cartes, ainsi que l’analyse de l’intelligence artificielle en entreprise, dont le quantique pourrait redéfinir certaines limites de calcul d’ici la fin de la décennie.